KI-Checker im Test – Werkzeug, Waffe oder Mogelpackung?

- Donna Macabenta

- 1 day ago

- 6 min read

Es klingt nach einer einfachen Idee. Ein Text wird in ein Online-Tool geladen, ein Algorithmus analysiert ihn – und wenige Sekunden später erscheint das Urteil: menschlich geschrieben oder KI-generiert. Sauber, schnell, objektiv. So zumindest die Verheißung eines Marktes, der in den vergangenen zwei Jahren explosionsartig gewachsen ist.

Die Realität sieht anders aus. Der Markt für KI-Detektoren ist intransparent, von kommerziellen Interessen durchzogen und in weiten Teilen schlicht unzuverlässig. Wer sich auf die Ergebnisse dieser Tools verlässt, ohne ihre Funktionsweise zu verstehen, trifft Entscheidungen auf der Basis von Zahlen, die weniger mit Wissenschaft zu tun haben als mit Verkaufsstrategie.

Wie KI-Checker funktionieren – und warum das Problem beginnt

Alle KI-Detektoren arbeiten nach demselben Grundprinzip. Sie analysieren statistische Muster in einem Text – Wortwahlwahrscheinlichkeiten, Satzstrukturvarianz, semantische Vorhersehbarkeit. Der Fachbegriff lautet Perplexity und Burstiness. Perplexity misst, wie überraschend die Wortwahl ist. Burstiness beschreibt, wie stark die Satzlänge variiert.

Die Theorie dahinter: KI-generierte Texte sind statistisch vorhersehbarer als menschlich geschriebene. Sie neigen zu gleichmäßigen Satzlängen, häufig verwendeten Wendungen und einer bestimmten Abfolge von Gedanken. Menschen schreiben unregelmäßiger, überraschender, persönlicher.

Das stimmt – in der Theorie. In der Praxis funktioniert diese Unterscheidung weit weniger zuverlässig als die Anbieter suggerieren.

„Kein KI-Detektor der Welt kann mit Sicherheit sagen, ob ein Text von einem Menschen oder einer Maschine stammt", sagt Marc Steinberg, Ghostwriter für Wirtschaftspublikationen. „Sie messen statistische Muster – keine Autorenschaft. Das ist ein fundamentaler Unterschied."

Das Geschäftsmodell hinter dem Urteil

Hier beginnt das eigentliche Problem. Ein erheblicher Teil der verfügbaren KI-Checker verfolgt kein neutrales Erkenntnisinteresse. Er verfolgt ein Geschäftsmodell.

Die Logik ist so simpel wie effektiv: Wer einen KI-Detektor anbietet, verkauft häufig auch das Gegenmittel – Software die Texte „humanisiert", also statistisch unauffälliger macht. Undetectable.ai ist dafür das bekannteste Beispiel. Das Tool prüft und humanisiert in einem Schritt, auf derselben Plattform, mit einem Klick.

Das Geschäftsmodell funktioniert nur dann, wenn der Checker möglichst viele Texte als KI-generiert einstuft. Ein neutrales Ergebnis bringt keinen Umsatz. Ein Alarm bringt den Nutzer dazu, das Humanisierungstool zu kaufen. Der Anreiz zur Verzerrung ist strukturell eingebaut – nicht durch böse Absicht, sondern durch die Natur des Geschäftsmodells.

Die Konsequenz ist in der Praxis nachweisbar und an manchen Stellen geradezu absurd. Wer den Test macht, lädt Goethes „Italienische Reise" in einen solchen Checker – und erhält die Meldung: 97 Prozent KI-generiert. Herman Melvilles „Moby Dick" schneidet kaum besser ab. Artikel aus Spiegel, Focus und FAZ, geschrieben von erfahrenen Redakteuren mit jahrzehntelanger Berufserfahrung, erhalten Werte zwischen 60 und 100 Prozent KI-Verdacht. Und in einem dokumentierten Fall erhielten die Zehn Gebote – rund 3.000 Jahre alt, lange vor der Erfindung des Computers entstanden – die Bewertung: 100 Prozent KI-generiert.

„Als mir ein Auftraggeber sagte, mein Text sei zu 89 Prozent KI-generiert, habe ich denselben Text durch sechs verschiedene Checker laufen lassen", berichtet Steinberg. „Die Ergebnisse lagen zwischen 4 und 91 Prozent. Derselbe Text. Sechs verschiedene Urteile. Das sagt alles."

Ein Markt voller Klone – wie aus einem Checker zwanzig werden

Was viele Nutzer nicht wissen: Der KI-Checker-Markt ist weit weniger vielfältig als er auf den ersten Blick wirkt. Hinter der Fassade unterschiedlicher Marken, Logos und Farbpaletten verbergen sich in vielen Fällen identische oder nahezu identische technische Grundlagen.

Das Phänomen ist aus anderen Software-Märkten bekannt – White-Label-Produkte, bei denen ein Anbieter seine Technologie an Dritte lizenziert, die daraus ein eigenes Produkt bauen. Im KI-Checker-Markt geschieht dasselbe. Ein Unternehmen entwickelt einen Algorithmus. Zehn weitere Unternehmen lizenzieren diesen Algorithmus, versehen ihn mit einem anderen Namen, einer anderen Benutzeroberfläche, einem anderen Farbschema – und verkaufen ihn als eigenständiges Produkt.

Der Nutzer glaubt, er erhalte eine zweite unabhängige Meinung. In Wirklichkeit fragt er dieselbe Maschine zweimal.

Erkennbar ist dieses Muster an mehreren Merkmalen: identische Ergebnisse bei denselben Texten, sehr ähnliche Prozentskalen, übereinstimmende Formulierungen in den Ergebnisberichten und oft auch identische Fehler bei bestimmten Texttypen. Wer zwei scheinbar verschiedene Checker mit demselben literarischen Klassiker testet und exakt dieselbe Prozentzahl erhält, hat sehr wahrscheinlich dieselbe Engine zweimal befragt.

Die bekannten Anbieter im Überblick

Der Markt lässt sich grob in drei Kategorien einteilen: kommerzielle Tools mit eingebautem Interessenkonflikt, neutrale Forschungstools und hybride Anbieter.

Undetectable.ai steht exemplarisch für die erste Kategorie. Das Tool ist offen darauf ausgerichtet, Texte als KI-generiert zu markieren – um dann die eigene Humanisierungsfunktion zu verkaufen. Die Trefferquote bei echten Menschentexten ist nachweislich niedrig.

Originality.ai richtet sich an Verlage und Content-Agenturen und wirbt mit hoher Präzision. Das Tool liefert differenziertere Ergebnisse als Undetectable, ist aber nicht frei von Fehlalarmen – besonders bei sachlich-strukturierten Texten die stilistisch an KI-Output erinnern.

Copyleaks kombiniert Plagiatserkennung mit KI-Detektion und ist in akademischen Institutionen verbreitet. Die KI-Erkennungsrate ist solide, aber auch hier gilt: Bei stark editierten oder stilistisch markanten Texten steigt die Fehlerquote.

ZeroGPT wurde von einem Studenten entwickelt und ist inzwischen eines der meistgenutzten Tools im akademischen Bereich. Es arbeitet transparent, veröffentlicht Informationen über seine Methodik und liefert Ergebnisse die differenzierter sind als die meisten kommerziellen Konkurrenten. ZeroGPT ist keine Verkaufsmaschine – es ist ein Forschungswerkzeug.

Um die Verwirrung komplett zu machen gibt es obendrein GPTZero, einen KI-Checker, der von der Humanisierung von KI-generierten Texten lebt. Die Unterschiede sind deutlich. Wer identische, handgeschriebene Texte bei ZeroGPT und bei GPTZero checken lässt, erhält höchst unterschiedliche Ergebnisse, wobei GPTZero fast immer behauptet, der Text sei von einer KI grschrieben.

Grammarly AI Detector ist in die bekannte Schreibhilfe integriert und profitiert von einer enormen Datenbasis. Das Tool liefert zuverlässige Ergebnisse bei klar KI-generierten Texten, ist aber konservativer in der Klassifizierung – was in der Praxis weniger Fehlalarme bedeutet.

QuillBot AI Check arbeitet ähnlich konservativ und ist besonders bei mehrsprachigen Texten stabiler als viele Konkurrenten. Da QuillBot kein eigenständiges Humanisierungstool verkauft, entfällt der strukturelle Anreiz zur Verzerrung.

Was neutrale Checker von kommerziellen unterscheidet

Die Unterschiede zwischen neutralen und kommerziell motivierten Checkern lassen sich an drei Merkmalen festmachen:

Transparenz der Methodik. Neutrale Tools wie GPTZero veröffentlichen Informationen darüber, wie sie arbeiten. Kommerzielle Tools mit Interessenkonflikt halten ihre Algorithmen zurück – oft mit dem Argument des Schutzes vor Manipulation. In der Praxis schützt diese Intransparenz vor allem das Geschäftsmodell.

Fehlerquote bei Menschentexten. Ein zuverlässiger Checker sollte klassische Literatur, journalistische Texte und akademische Prosa zuverlässig als menschlich erkennen. Tools die bei Goethe oder Melville versagen, sind für die professionelle Praxis unbrauchbar.

Kommerzielles Interesse am Ergebnis. Wer neben dem Checker auch das Gegenmittel verkauft, hat ein strukturelles Interesse daran, möglichst viele Texte als KI-generiert einzustufen. Dieses Interesse ist nicht per se unethisch – aber es muss bei der Bewertung der Ergebnisse berücksichtigt werden.

„Ich empfehle meinen Auftraggebern immer, mindestens zwei voneinander unabhängige Checker zu nutzen", sagt Steinberg. „Und mit unabhängig meine ich: verschiedene technische Grundlagen, verschiedene Anbieter, verschiedene Geschäftsmodelle. Wer zweimal GPTZero und einmal ein White-Label-Produkt desselben Algorithmus nutzt, hat dreimal dieselbe Meinung eingeholt."

Was die Zahlen wirklich bedeuten

Ein KI-Checker liefert keine Wahrheit. Er liefert eine Wahrscheinlichkeit – berechnet auf Basis statistischer Muster, die mit der tatsächlichen Autorenschaft nur indirekt zusammenhängen.

Ein Text der zu 78 Prozent als KI-generiert eingestuft wird, ist nicht zu 78 Prozent von einer Maschine geschrieben. Er weist zu 78 Prozent statistische Muster auf, die dem Algorithmus des jeweiligen Tools verdächtig erscheinen. Das ist ein fundamentaler Unterschied.

Sachliche, strukturierte, fachlich dichte Texte erhalten grundsätzlich höhere KI-Verdachtswerte als emotionale, anekdotische oder stilistisch eigenwillige Texte. Ein Jahresbericht klingt statistisch maschineller als ein Liebesbrief – unabhängig davon, wer ihn geschrieben hat.

Das bedeutet für die Praxis: Ghostwriting-Auftraggeber die ihre Texte einem KI-Check unterziehen, sollten die Ergebnisse als einen Datenpunkt von mehreren behandeln – nicht als abschließendes Urteil. Ein Wert unter 25 Prozent bei zwei unabhängigen, neutralen Checkern ist ein glaubwürdiger Hinweis, dass keine KI oder nur sehr wenig im Spiel war. Ein Wert über 50 Prozent bei einem einzigen kommerziellen Tool ist aber kein Beweis für irgendetwas.

Ein Gedanke zu den Humanisierungs-Tools

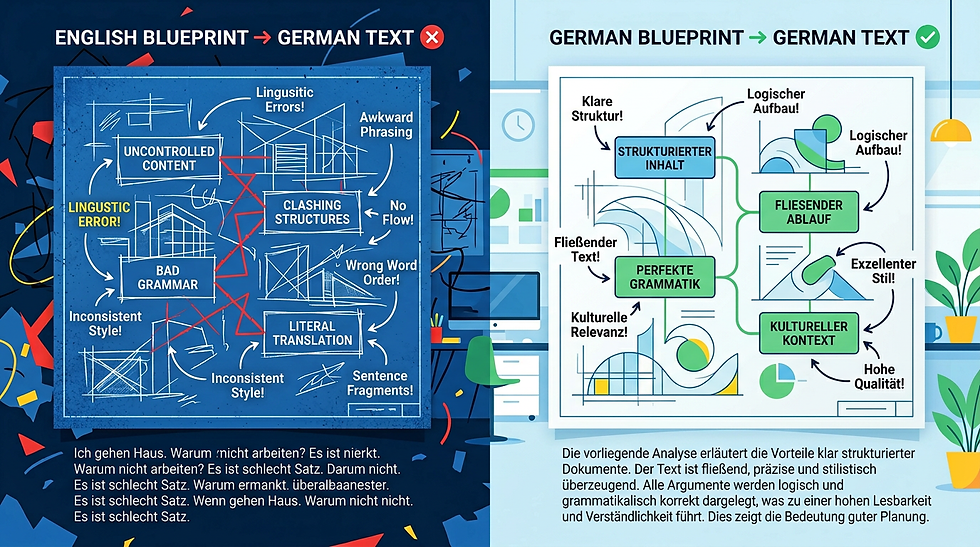

Es werden von etlichen Labeln Tools angeboten, die angeblich KI-generierte Texte in menschlichen Content verwandeln können. Habe ich ausprobiert und ich war überrascht, wie grottenschlecht diese Tools teilweise waren. Einige haben den Text zur Unkenntlichkeit verstümmelt, andere kennen die grammatikalischen Regeln nicht. Ich habe nicht ein Tool gefunden, das zufriedenstellende Ergebnisse liefern konnte. Das hätte mich auch gewundert, denn wenn das so einfach wäre, dann wäre das Humanisieren von Texten in Gemini 3.1, Gemini Flash 1.5, Claude Sonnet oder Opus und GPT5 ganz sicher ein integrierter Teil der künstlichen Intelligenz. Genau hier liegt der Grund dafür, dass KI-Texte abschließend von einem Menschen nachbearbeitet werden müssen, der die Kunst des Schreibens beherrscht und der zum Text-Thema über ausreichend Fachwissen verfügt.

Was bleibt

Der Markt für KI-Checker wird nicht verschwinden. Er wird wachsen – weil die Menge an KI-generiertem Content wächst und weil der Bedarf nach Überprüfung real ist. Aber er wird sich konsolidieren. Tools die systematisch versagen, verlieren Vertrauen. Tools die transparent arbeiten und zuverlässige Ergebnisse liefern, setzen sich durch.

Kritisch dabei ist, dass die KIs mit rasanter Geschwindigkeit immer besser werden und die KI-Checker große Probleme haben, mit diesem Eiltempo Schritt zu halten.

Bis dahin gilt für professionelle Anwender eine einfache Regel: Kein einzelnes Tool entscheidet. Kein Ergebnis ist absolut. Und wer einen Checker nutzt, der gleichzeitig das Gegenmittel verkauft, sollte die Ergebnisse mit der angemessenen Skepsis behandeln.

„Das Problem ist nicht die KI", sagt Steinberg. „Das Problem ist, dass wir Werkzeuge zur Wahrheitsfindung einsetzen, die selbst ein Interesse am Ergebnis haben. Das war in der Geschichte des Journalismus immer eine schlechte Idee."

Autor: Apollo O. Bruckner | PENYA – Autorenbüro auf Leyte, Philippinen

Comments